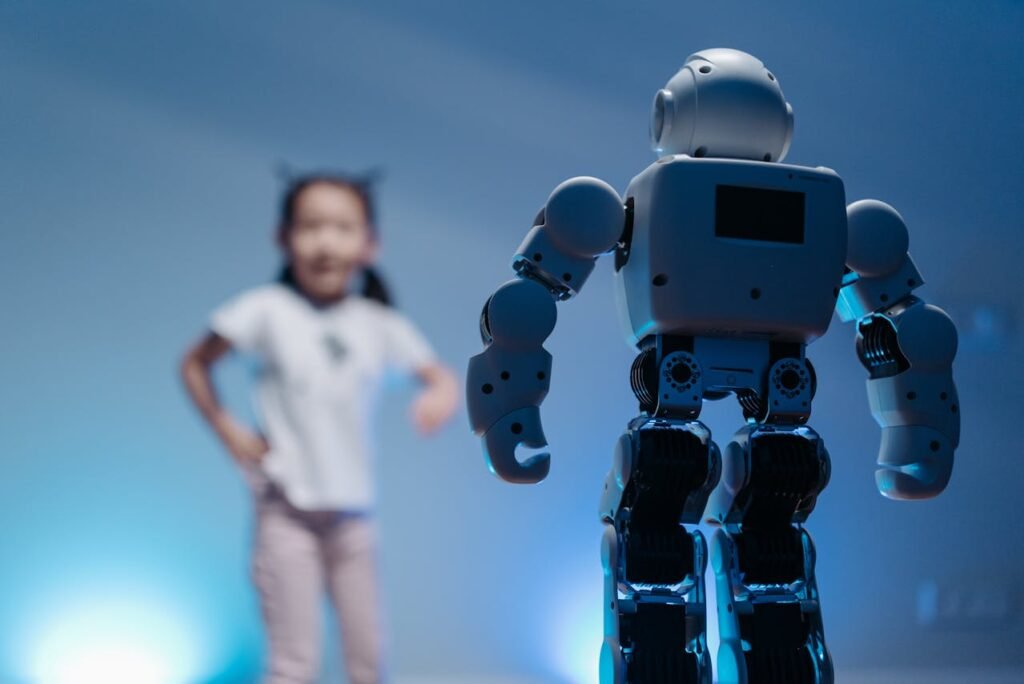

A Meta Platforms anunciou que, nas próximas semanas, adolescentes deixarão de ter acesso aos seus personagens de inteligência artificial em todos os aplicativos do grupo — Facebook, Instagram, Messenger e WhatsApp. A suspensão é global e permanecerá em vigor até que a empresa conclua uma versão redesenhada da experiência, equipada com novas ferramentas de supervisão familiar.

Medida preventiva enquanto novos filtros são implementados

Segundo a companhia, a interrupção temporária tem como objetivo garantir a segurança digital de utilizadores com menos de 18 anos. Até que o sistema seja reapresentado, adolescentes não poderão iniciar nem continuar conversas com os chatbots de IA disponibilizados pela Meta desde o ano passado.

O plano de reativação inclui a introdução de controlos parentais que permitirão aos responsáveis limitar ou desativar totalmente o acesso dos filhos aos personagens virtuais. A Meta já havia apresentado, em outubro, uma prévia desses controlos, capazes de bloquear chats privados entre menores e IA. Contudo, a funcionalidade ainda não chegou ao público, motivo pelo qual a empresa decidiu retirar o recurso do ar enquanto finaliza os ajustes técnicos e define diretrizes de uso.

Durante o período de inatividade, os personagens continuarão disponíveis apenas para maiores de idade. Usuários adolescentes que tentarem iniciar conversas receberão notificações informando sobre a suspensão temporária e orientações sobre os próximos passos.

Classificação PG-13 e pressão regulatória

Quando voltar a ser oferecida, a interação entre adolescentes e IA seguirá parâmetros inspirados no sistema de classificação de filmes PG-13. A empresa afirma que esse enquadramento ajudará a filtrar conteúdos considerados impróprios para menores, evitando temas de violência explícita, linguagem ofensiva ou conotação sexual.

A iniciativa responde a críticas de organizações da sociedade civil e de reguladores norte-americanos que vêm aumentando a fiscalização sobre potenciais riscos dos chatbots. Em investigações recentes, autoridades identificaram ocasiões em que as diretrizes internas da Meta permitiram trocas de conteúdo sugestivo entre o assistente virtual e utilizadores adolescentes.

Especialistas em proteção infantil alertam que a natureza conversacional da inteligência artificial pode facilitar a exposição de menores a material inadequado ou a orientações perigosas. Isso levou órgãos reguladores a exigir transparência, limites etários claros e mecanismos de denúncia. Ao adotar a classificação PG-13, a Meta pretende estabelecer um padrão de referência que simplifique a auditoria externa e demonstre compromisso com a segurança infantojuvenil.

Imagem: Internet

Impacto para usuários e próximos passos

A suspensão altera a experiência de milhões de adolescentes que começaram a explorar os personagens de IA nos últimos meses. Para eles, funcionalidades de ajuda com estudos, criação de conteúdos e entretenimento ficarão temporariamente indisponíveis. Já os pais e encarregados de educação receberão orientações sobre como ativar as novas configurações assim que forem liberadas.

Em comunicado, a Meta informou que divulgará detalhes técnicos do sistema revisto antes do relançamento. A empresa não indicou prazo específico, mas assegura que a retomada ocorrerá apenas quando todas as salvaguardas estiverem operacionais.

Além dos controlos parentais, a Meta avalia incluir alertas de contexto durante as conversas, reforçando que se trata de uma inteligência artificial, não de uma pessoa real. Recomendações de uso responsável e canais de feedback também fazem parte do pacote em desenvolvimento.

A decisão da Meta reforça a tendência do setor de tecnologia de recuar ou ajustar funcionalidades envolvendo IA sempre que surgem dúvidas sobre segurança de crianças e adolescentes. Plataformas concorrentes têm adotado condutas semelhantes, sinalizando que a regulação — mesmo quando não obrigatória — se torna determinante para a continuidade de projetos de inteligência artificial voltados ao público mais jovem.